Hadoop集成Kerberos

1. 前置条件

在Hadoop集群上安装Kerberos后,如果Hadoop开启Kerberos,需为不同服务准备不同的用户,启动服务时需要使用相应的用户。所以须在所有节点创建以下用户和用户组。

| 用户:用户组 | 服务组成 |

|---|---|

| hdfs:hadoop | NameNode\SecondaryNameNode JournalNode\DataNode |

| yarn:hadoop | ResourceManager\NodeManager |

| mapred:hadoop | MapReduce JobHistory Server |

1.1 创建hadoop用户组

[root@hadoop102 ~]# groupadd hadoop

[root@hadoop103 ~]# groupadd hadoop

[root@hadoop104 ~]# groupadd hadoop1.2 创建用户并设置密码

## 在三台机器上分别执行

[root@hadoop102 ~]# useradd hdfs -g hadoop

## 第一个hdfs为密码,由于passwd命令是交互式的,使用如下方式可以直接设置指定密码

[root@hadoop102 ~]# echo hdfs | passwd --stdin hdfs

[root@hadoop102 ~]# useradd yarn -g hadoop

[root@hadoop102 ~]# echo yarn | passwd --stdin yarn

[root@hadoop102 ~]# useradd mapred -g hadoop

[root@hadoop102 ~]# echo mapred | passwd --stdin mapred2. Kerberos配置

2.1 创建Principal规划

下面为各个服务创建Kerberos主体(Principal)。各个服务所需主体清单如下:

主体格式如下:ServiceName/HostName@REALM, 例如dn/hadoop102@EXAMPLE.COM

| 服务 | 所在主机 | 主体(Principal) |

|---|---|---|

| NameNode | hadoop102 | nn/hadoop102 |

| DataNode | hadoop102 | dn/hadoop102 |

| DataNode | hadoop103 | dn/hadoop103 |

| DataNode | hadoop104 | dn/hadoop104 |

| Secondary NameNode | hadoop104 | sn/hadoop104 |

| ResourceManager | hadoop103 | rm/hadoop103 |

| NodeManager | hadoop102 | nm/hadoop102 |

| NodeManager | hadoop103 | nm/hadoop103 |

| NodeManager | hadoop104 | nm/hadoop104 |

| JobHistory Server | hadoop102 | jhs/hadoop102 |

| WebUI | hadoop102 | HTTP/hadoop102 |

| WebUI | hadoop103 | HTTP/hadoop103 |

| WebUI | hadoop104 | HTTP/hadoop104 |

2.2 创建主体

- 路径准备

为各个服务准备一个安全的路径用来存储keytab文件。sh## 在hadoop102\hadoop103\hadoop104上执行 [root@hadoop102 ~]# mkdir /etc/security/keytab [root@hadoop102 ~]# chown -R root:hadoop /etc/security/keytab [root@hadoop102 ~]# chmod 770 /etc/security/keytab - 管理员主体认证

为执行创建主体语句,需登录Kerberos数据库客户端,使用管理员用户远程登录:sh## 省去交互,直接执行 ## 在hadoop102上执行 kadmin -padmin/admin -wadmin -q"addprinc -randkey nn/hadoop102" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/nn.service.keytab nn/hadoop102" kadmin -padmin/admin -wadmin -q"addprinc -randkey dn/hadoop102" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/dn.service.keytab dn/hadoop102" kadmin -padmin/admin -wadmin -q"addprinc -randkey nm/hadoop102" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/nm.service.keytab nm/hadoop102" kadmin -padmin/admin -wadmin -q"addprinc -randkey jhs/hadoop102" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/jhs.service.keytab jhs/hadoop102" kadmin -padmin/admin -wadmin -q"addprinc -randkey HTTP/hadoop102" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/HTTP.service.keytab HTTP/hadoop102" ## 在hadoop103上执行 kadmin -padmin/admin -wadmin -q"addprinc -randkey dn/hadoop103" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/dn.service.keytab dn/hadoop103" kadmin -padmin/admin -wadmin -q"addprinc -randkey rm/hadoop103" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/rm.service.keytab rm/hadoop103" kadmin -padmin/admin -wadmin -q"addprinc -randkey nm/hadoop103" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/nm.service.keytab nm/hadoop103" kadmin -padmin/admin -wadmin -q"addprinc -randkey HTTP/hadoop103" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/HTTP.service.keytab HTTP/hadoop103" ## 在hadoop104上执行 kadmin -padmin/admin -wadmin -q"addprinc -randkey dn/hadoop104" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/dn.service.keytab dn/hadoop104" kadmin -padmin/admin -wadmin -q"addprinc -randkey sn/hadoop104" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/sn.service.keytab sn/hadoop104" kadmin -padmin/admin -wadmin -q"addprinc -randkey nm/hadoop104" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/dn.service.keytab nm/hadoop104" kadmin -padmin/admin -wadmin -q"addprinc -randkey HTTP/hadoop104" kadmin -padmin/admin -wadmin -q"xst -k /etc/security/keytab/HTTP.service.keytab HTTP/hadoop104"

2.3 修改keytab权限

我们启动服务是使用对应用户去启动,需要有权限能够读取keytab文件:

## 可以看到文件只能root去读取,并且用户组和其他用户都没有读取权限

[root@node01 keytab]# ll /etc/security/keytab/

总用量 20

-rw-------. 1 root root 498 11月 1 23:30 dn.service.keytab

-rw-------. 1 root root 512 11月 1 23:30 HTTP.service.keytab

-rw-------. 1 root root 505 11月 1 23:30 jhs.service.keytab

-rw-------. 1 root root 498 11月 1 23:30 nm.service.keytab

-rw-------. 1 root root 498 11月 1 23:30 nn.service.keytab

## 修改权限, 在hadoop102\hadoop103\hadoop104上执行

chown -R root:hadoop /etc/security/keytab/*

chmod 660 /etc/security/keytab/*3. 修改Hadoop配置文件

3.1 core-site.xml

<!--Kerberos主体到系统用户的映射机制-->

<property>

<name>hadoop.security.auth_to_local.mechanism</name>

<value>MIT</value>

</property>

<!--Kerberos主体到系统用户的具体映射机制,其实就是Kerberos主体转换成系统用户-->

<property>

<name>hadoop.security.auth_to_local</name>

<value>

RULE:[2:$1/$2@$0]([ndj]n/.*@REALM.\TLD)s/.*/hdfs/

RULE:[2:$1/$2@$0]([rn]m/.*@REALM\.TLD)s/.*/yarn/

RULE:[2:$1/$2@$0](jhs/.*@REALM\.TLD)s/.*/mapred/

DEFAULT

</value>

</property>

<!--启用 Hadoop 集群 Kerberos 安全认证-->

<property>

<name>hadoop.security.authentication</name>

<value>kerberos</value>

</property>

<!-- 启用Hadoop集群Kerberos安全认证 -->

<property>

<name>hadoop.security.authentication</name>

<value>kerberos</value>

</property>

<!-- 启用Hadoop集群授权管理 -->

<property>

<name>hadoop.security.authorization</name>

<value>true</value>

</property>

<!-- Hadoop集群间RPC通讯设为仅认证模式 -->

<property>

<name>hadoop.rpc.protection</name>

<value>authentication</value>

</property>3.2 hdfs-site.xml

其中_HOST会被Hadoop自动转换为当前所在机器的主机名

<!-- 访问DataNode数据块时需通过Kerberos认证 -->

<property>

<name>dfs.block.access.token.enable</name>

<value>true</value>

</property>

<!-- NameNode服务的Kerberos主体,_HOST会自动解析为服务所在的主机名 -->

<property>

<name>dfs.namenode.kerberos.principal</name>

<value>nn/_HOST@EXAMPLE.COM</value>

</property>

<!-- NameNode服务的Kerberos密钥文件路径 -->

<property>

<name>dfs.namenode.keytab.file</name>

<value>/etc/security/keytab/nn.service.keytab</value>

</property>

<!-- Secondary NameNode服务的Kerberos密钥文件路径 -->

<property>

<name>dfs.secondary.namenode.keytab.file</name>

<value>/etc/security/keytab/sn.service.keytab</value>

</property>

<!-- Secondary NameNode服务的Kerberos主体 -->

<property>

<name>dfs.secondary.namenode.kerberos.principal</name>

<value>sn/_HOST@EXAMPLE.COM</value>

</property>

<!-- NameNode Web服务的Kerberos主体 -->

<property>

<name>dfs.namenode.kerberos.internal.spnego.principal</name>

<value>HTTP/_HOST@EXAMPLE.COM</value>

</property>

<!-- WebHDFS REST服务的Kerberos主体 -->

<property>

<name>dfs.web.authentication.kerberos.principal</name>

<value>HTTP/_HOST@EXAMPLE.COM</value>

</property>

<!-- Secondary NameNode Web UI服务的Kerberos主体 -->

<property>

<name>dfs.secondary.namenode.kerberos.internal.spnego.principal</name>

<value>HTTP/_HOST@EXAMPLE.COM</value>

</property>

<!-- Hadoop Web UI的Kerberos密钥文件路径 -->

<property>

<name>dfs.web.authentication.kerberos.keytab</name>

<value>/etc/security/keytab/HTTP.service.keytab</value>

</property>

<!-- DataNode服务的Kerberos主体 -->

<property>

<name>dfs.datanode.kerberos.principal</name>

<value>dn/_HOST@EXAMPLE.COM</value>

</property>

<!-- DataNode服务的Kerberos密钥文件路径 -->

<property>

<name>dfs.datanode.keytab.file</name>

<value>/etc/security/keytab/dn.service.keytab</value>

</property>

<!-- 配置NameNode Web UI 使用HTTPS协议 -->

<property>

<name>dfs.http.policy</name>

<value>HTTPS_ONLY</value>

</property>

<!-- 配置DataNode数据传输保护策略为仅认证模式 -->

<property>

<name>dfs.data.transfer.protection</name>

<value>authentication</value>

</property>3.3 yarn-site.xml

<!-- Resource Manager 服务的Kerberos主体 -->

<property>

<name>yarn.resourcemanager.principal</name>

<value>rm/_HOST@EXAMPLE.COM</value>

</property>

<!-- Resource Manager 服务的Kerberos密钥文件 -->

<property>

<name>yarn.resourcemanager.keytab</name>

<value>/etc/security/keytab/rm.service.keytab</value>

</property>

<!-- Node Manager 服务的Kerberos主体 -->

<property>

<name>yarn.nodemanager.principal</name>

<value>nm/_HOST@EXAMPLE.COM</value>

</property>

<!-- Node Manager 服务的Kerberos密钥文件 -->

<property>

<name>yarn.nodemanager.keytab</name>

<value>/etc/security/keytab/nm.service.keytab</value>

</property>3.4 maprd-site.xml

<!-- 历史服务器的Kerberos主体 -->

<property>

<name>mapreduce.jobhistory.keytab</name>

<value>/etc/security/keytab/jhs.service.keytab</value>

</property>

<!-- 历史服务器的Kerberos密钥文件 -->

<property>

<name>mapreduce.jobhistory.principal</name>

<value>jhs/_HOST@EXAMPLE.COM</value>

</property>4. 配置HDFS使用HTTPS

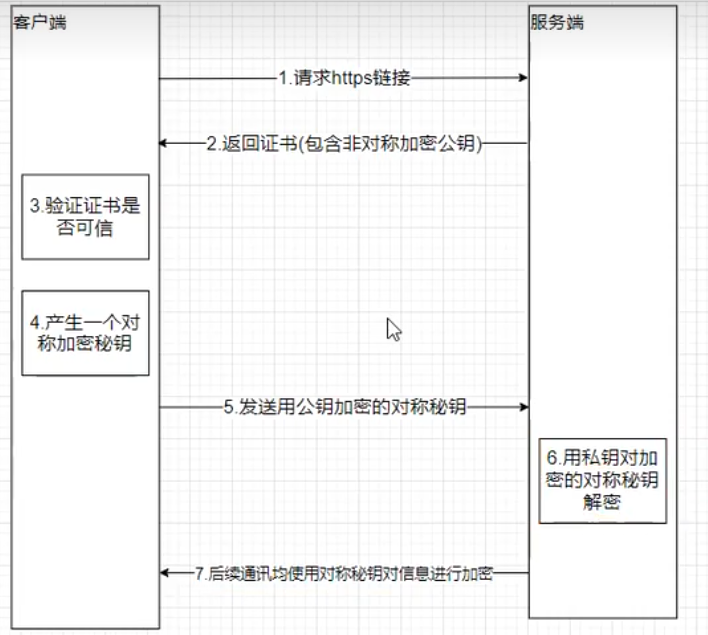

4.1 HTTPS原理

可以看出服务端如果要返回证书(公钥)给客户端,需要有一个提前准备生成。

可以看出服务端如果要返回证书(公钥)给客户端,需要有一个提前准备生成。

4.2 生成密钥对

Keytool是java数据证书的管理工具,使用户能够管理自己的公/私钥对及相关证书。

keystore指定密钥库的名称及位置(产生的各类信息将存在.keystore文件中)genkey(或者-genkeypair)生成密钥对alias为生成的密钥对指定别名,如果没有默认是mykeykeyalg指定密钥的算法 RSA/DSA 默认是DSA

# 生成 keystore的密码及相应信息的密钥库

keytool -keystore /etc/security/keytab/keystore -alias jetty -genkey -keyalg RSA

输入密钥库口令:

再次输入新口令:

您的名字与姓氏是什么?

[Unknown]:

您的组织单位名称是什么?

[Unknown]:

您的组织名称是什么?

[Unknown]:

您所在的城市或区域名称是什么?

[Unknown]:

您所在的省/市/自治区名称是什么?

[Unknown]:

该单位的双字母国家/地区代码是什么?

[Unknown]:

CN=Unknown, OU=Unknown, O=Unknown, L=Unknown, ST=Unknown, C=Unknown是否正确?

[否]: y

## 密码可以设置为123456

输入 <jetty> 的密钥口令

(如果和密钥库口令相同, 按回车):

再次输入新口令:修改keystore文件的所有者和访问权限:

[root@hadoop102 ~]# chown -R root:hadoop /etc/security/keytab/keystore

[root@hadoop102 ~]# chmod 660 /etc/security/keytab/keystore

## 将该证书分发到集群中的每台节点的相同路径

[root@hadoop102 ~]# xsync /etc/security/keytab/keystore4.3 修改hadoop配置文件

在$HADOOP_HOME/etc/hadoop目录下有ssl-server.xml.example文件:

[root@hadoop102 ~]# mv $HADOOP_HOME/etc/hadoop/ssl-server.xml.example $HADOOP_HOME/etc/hadoop/ssl-server.xml

## 修改以下内容

<!-- SSL密钥库路径 -->

<property>

<name>ssl.server.keystore.location</name>

<value>/etc/security/keytab/keystore</value>

</property>

<!-- SSL密钥库密码 -->

<property>

<name>ssl.server.keystore.password</name>

<value>123456</value>

</property>

<!-- SSL可信任密钥库路径 -->

<property>

<name>ssl.server.truststore.location</name>

<value>/etc/security/keytab/keystore</value>

</property>

<!-- SSL密钥库中密钥的密码 -->

<property>

<name>ssl.server.keystore.keypassword</name>

<value>123456</value>

</property>

<!-- SSL可信任密钥库密码 -->

<property>

<name>ssl.server.truststore.password</name>

<value>123456</value>

</property>分发ssl-server.xml文件:

[root@hadoop102 ~]# xsync $HADOOP_HOME/etc/hadoop/ssl-server.xml5. 配置Yarn使用LinuxContainerExecutor

LinuxContainerExecutor就是用来启动Container用的,方便后续mapreduce任务在Container执行。

5.1 修改所有节点container-executor所有者和权限

# 要求其所有者为root,所有组为hadoop,权限为6050

[root@hadoop102 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/bin/container-executor

[root@hadoop102 ~]# chmod 6050 /opt/module/hadoop-3.1.3/bin/container-executor

[root@hadoop103 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/bin/container-executor

[root@hadoop103 ~]# chmod 6050 /opt/module/hadoop-3.1.3/bin/container-executor

[root@hadoop104 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/bin/container-executor

[root@hadoop104 ~]# chmod 6050 /opt/module/hadoop-3.1.3/bin/container-executor5.2 修改所有节点container-executor.cfg所有者和权限

## # 要求其所有者为root,所有组为hadoop,权限为400

[root@hadoop102 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg

[root@hadoop102 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop

[root@hadoop102 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc

[root@hadoop102 ~]# chown root:hadoop /opt/module/hadoop-3.1.3

[root@hadoop102 ~]# chown root:hadoop /opt/module

[root@hadoop102 ~]# chmod 400 /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg

[root@hadoop103 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg

[root@hadoop103 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop

[root@hadoop103 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc

[root@hadoop103 ~]# chown root:hadoop /opt/module/hadoop-3.1.3

[root@hadoop103 ~]# chown root:hadoop /opt/module

[root@hadoop103 ~]# chmod 400 /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg

[root@hadoop104 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg

[root@hadoop104 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc/hadoop

[root@hadoop104 ~]# chown root:hadoop /opt/module/hadoop-3.1.3/etc

[root@hadoop104 ~]# chown root:hadoop /opt/module/hadoop-3.1.3

[root@hadoop104 ~]# chown root:hadoop /opt/module

[root@hadoop104 ~]# chmod 400 /opt/module/hadoop-3.1.3/etc/hadoop/container-executor.cfg修改$HADOOP_HOME/etc/hadoop/container-executor.cfg

[root@hadoop102 ~]# vim $HADOOP_HOME/etc/hadoop/container-executor.cfg

## 内容如下 非系统用户的userid就是从1000开始的

yarn.nodemanager.linux-container-executor.group=hadoop

banned.users=hdfs,yarn,mapred

min.user.id=1000

allowed.system.users=

feature.tc.enabled=false5.3 配置yarn-site.xml文件

[root@hadoop102 ~]# vim $HADOOP_HOME/etc/hadoop/yarn-site.xml

增加以下内容

<!-- 配置Node Manager使用LinuxContainerExecutor管理Container -->

<property>

<name>yarn.nodemanager.container-executor.class</name>

<value>org.apache.hadoop.yarn.server.nodemanager.LinuxContainerExecutor</value>

</property>

<!-- 配置Node Manager的启动用户的所属组 -->

<property>

<name>yarn.nodemanager.linux-container-executor.group</name>

<value>hadoop</value>

</property>

<!-- LinuxContainerExecutor脚本路径 -->

<property>

<name>yarn.nodemanager.linux-container-executor.path</name>

<value>/opt/module/hadoop-3.1.3/bin/container-executor</value>

</property>分发container-executor.cfg和yarn-site.xml文件:

[root@hadoop102 ~]# xsync $HADOOP_HOME/etc/hadoop/container-executor.cfg

[root@hadoop102 ~]# xsync $HADOOP_HOME/etc/hadoop/yarn-site.xml6. 安全模式下启动Hadoop集群

6.1 修改特定本地路径权限

| $HADOOP_LOG_DIR | hdfs:hadoop | drwxrwxr-x |

|---|---|---|

| dfs.namenode.name.dir | hdfs:hadoop | drwx------ |

| dfs.datanode.data.dir | hdfs:hadoop | drwx------ |

| dfs.namenode.checkpoint.dir | hdfs:hadoop | drwx------ |

| yarn.nodemanager.local-dirs | yarn:hadoop | drwxrwxr-x |

| yarn.nodemanager.log-dirs | yarn:hadoop | drwxrwxr-x |

- $HADOOP_LOG_DIRsh

## 该变量位于hadoop-env.sh文件,默认值为 ${HADOOP_HOME}/logs [root@hadoop102 ~]# chown hdfs:hadoop /opt/module/hadoop-3.1.3/logs/ [root@hadoop102 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/ [root@hadoop103 ~]# chown hdfs:hadoop /opt/module/hadoop-3.1.3/logs/ [root@hadoop103 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/ [root@hadoop104 ~]# chown hdfs:hadoop /opt/module/hadoop-3.1.3/logs/ [root@hadoop104 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/ - dfs.namenode.name.dir(NameNode节点)sh

## 该参数位于hdfs-site.xml文件,默认值为file://${hadoop.tmp.dir}/dfs/name [root@hadoop102 ~]# chown -R hdfs:hadoop /opt/module/hadoop-3.1.3/data/dfs/name/ [root@hadoop102 ~]# chmod 700 /opt/module/hadoop-3.1.3/data/dfs/name/ - dfs.datanode.data.dir(DataNode节点)sh

## 该参数为于hdfs-site.xml文件,默认值为file://${hadoop.tmp.dir}/dfs/data [root@hadoop102 ~]# chown -R hdfs:hadoop /opt/module/hadoop-3.1.3/data/dfs/data/ [root@hadoop102 ~]# chmod 700 /opt/module/hadoop-3.1.3/data/dfs/data/ [root@hadoop103 ~]# chown -R hdfs:hadoop /opt/module/hadoop-3.1.3/data/dfs/data/ [root@hadoop103 ~]# chmod 700 /opt/module/hadoop-3.1.3/data/dfs/data/ [root@hadoop104 ~]# chown -R hdfs:hadoop /opt/module/hadoop-3.1.3/data/dfs/data/ [root@hadoop104 ~]# chmod 700 /opt/module/hadoop-3.1.3/data/dfs/data/ - dfs.namenode.checkpoint.dir(SecondaryNameNode节点)sh

## 该参数位于hdfs-site.xml文件,默认值为file://${hadoop.tmp.dir}/dfs/namesecondary [root@hadoop104 ~]# chown -R hdfs:hadoop /opt/module/hadoop-3.1.3/data/dfs/namesecondary/ [root@hadoop104 ~]# chmod 700 /opt/module/hadoop-3.1.3/data/dfs/namesecondary/ - yarn.nodemanager.local-dirs(NodeManager节点)sh

## 该参数位于yarn-site.xml文件,默认值为file://${hadoop.tmp.dir}/nm-local-dir [root@hadoop102 ~]# chown -R yarn:hadoop /opt/module/hadoop-3.1.3/data/nm-local-dir/ [root@hadoop102 ~]# chmod -R 775 /opt/module/hadoop-3.1.3/data/nm-local-dir/ [root@hadoop103 ~]# chown -R yarn:hadoop /opt/module/hadoop-3.1.3/data/nm-local-dir/ [root@hadoop103 ~]# chmod -R 775 /opt/module/hadoop-3.1.3/data/nm-local-dir/ [root@hadoop104 ~]# chown -R yarn:hadoop /opt/module/hadoop-3.1.3/data/nm-local-dir/ [root@hadoop104 ~]# chmod -R 775 /opt/module/hadoop-3.1.3/data/nm-local-dir/ - yarn.nodemanager.log-dirs(NodeManager节点)sh

## 该参数位于yarn-site.xml文件,默认值为$HADOOP_LOG_DIR/userlogs [root@hadoop102 ~]# chown yarn:hadoop /opt/module/hadoop-3.1.3/logs/userlogs/ [root@hadoop102 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/userlogs/ [root@hadoop103 ~]# chown yarn:hadoop /opt/module/hadoop-3.1.3/logs/userlogs/ [root@hadoop103 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/userlogs/ [root@hadoop104 ~]# chown yarn:hadoop /opt/module/hadoop-3.1.3/logs/userlogs/ [root@hadoop104 ~]# chmod 775 /opt/module/hadoop-3.1.3/logs/userlogs/

6.2 启动HDFS

需要注意的是,启动不同服务时需要使用对应的用户。

- 单个启动方式sh

## 启动NameNode [root@hadoop102 ~]# sudo -i -u hdfs hdfs --daemon start namenode ## 启动DataNode [root@hadoop102 ~]# sudo -i -u hdfs hdfs --daemon start datanode [root@hadoop103 ~]# sudo -i -u hdfs hdfs --daemon start datanode [root@hadoop104 ~]# sudo -i -u hdfs hdfs --daemon start datanode ## 启动SecondaryNameNode [root@hadoop104 ~]# sudo -i -u hdfs hdfs --daemon start secondarynamenode说明

-i:重新加载环境变量-u:以特定用户的身份执行后续命令 - 群起方式sh

## 1. 在主节点(hadoop102)配置hdfs用户到所有节点的免密登录。 ## 2. 修改主节点(hadoop102)节点的$HADOOP_HOME/sbin/start-dfs.sh脚本,在顶部增加以下环境变量。 [root@hadoop102 ~]# vim $HADOOP_HOME/sbin/start-dfs.sh ## 在顶部增加如下内容 HDFS_DATANODE_USER=hdfs HDFS_NAMENODE_USER=hdfs HDFS_SECONDARYNAMENODE_USER=hdfs [root@hadoop102 ~]# vim $HADOOP_HOME/sbin/stop-dfs.sh ## 在顶部增加如下内容 HDFS_DATANODE_USER=hdfs HDFS_NAMENODE_USER=hdfs HDFS_SECONDARYNAMENODE_USER=hdfs ## 以root用户执行群起脚本,即可启动HDFS集群。 [root@hadoop102 ~]# start-dfs.sh

6.3 查看HFDS web页面

6.4 修改HDFS特定路径访问权限

| hdfs | / | hdfs:hadoop | drwxr-xr-x |

|---|---|---|---|

| hdfs | /tmp | hdfs:hadoop | drwxrwxrwxt |

| hdfs | /user | hdfs:hadoop | drwxrwxr-x |

| hdfs | yarn.nodemanager.remote-app-log-dir | yarn:hadoop | drwxrwxrwxt |

| hdfs | mapreduce.jobhistory.intermediate-done-dir | mapred:hadoop | drwxrwxrwxt |

| hdfs | mapreduce.jobhistory.done-dir | mapred:hadoop | drwxrwx--- |

若上述路径不存在,需手动创建。

## 创建hdfs/hadoop主体,执行以下命令并按照提示输入密码

[root@hadoop102 ~]# kadmin.local -q "addprinc hdfs/hadoop"

## 认证hdfs/hadoop主体,执行以下命令并按照提示输入密码

[root@hadoop102 ~]# kinit hdfs/hadoop

## 修改/、/tmp、/user路径

[root@hadoop102 ~]# hadoop fs -chown hdfs:hadoop / /tmp /user

[root@hadoop102 ~]# hadoop fs -chmod 755 /

[root@hadoop102 ~]# hadoop fs -chmod 1777 /tmp

[root@hadoop102 ~]# hadoop fs -chmod 775 /user

## 参数yarn.nodemanager.remote-app-log-dir位于yarn-site.xml文件,默认值/tmp/logs

[root@hadoop102 ~]# hadoop fs -chown yarn:hadoop /tmp/logs

[root@hadoop102 ~]# hadoop fs -chmod 1777 /tmp/logs

## 参数mapreduce.jobhistory.intermediate-done-dir位于mapred-site.xml文件,默认值为/tmp/hadoop-yarn/staging/history/done_intermediate,需保证该路径的所有上级目录(除/tmp)的所有者均为mapred,所属组为hadoop,权限为770

[root@hadoop102 ~]# hadoop fs -chown -R mapred:hadoop /tmp/hadoop-yarn/staging/history/done_intermediate

[root@hadoop102 ~]# hadoop fs -chmod -R 1777 /tmp/hadoop-yarn/staging/history/done_intermediate

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/staging/history/

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/staging/

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/staging/history/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/staging/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/

## 参数mapreduce.jobhistory.done-dir位于mapred-site.xml文件,默认值为/tmp/hadoop-yarn/staging/history/done,需保证该路径的所有上级目录(除/tmp)的所有者均为mapred,所属组为hadoop,权限为770

[root@hadoop102 ~]# hadoop fs -chown -R mapred:hadoop /tmp/hadoop-yarn/staging/history/done

[root@hadoop102 ~]# hadoop fs -chmod -R 750 /tmp/hadoop-yarn/staging/history/done

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/staging/history/

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/staging/

[root@hadoop102 ~]# hadoop fs -chown mapred:hadoop /tmp/hadoop-yarn/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/staging/history/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/staging/

[root@hadoop102 ~]# hadoop fs -chmod 770 /tmp/hadoop-yarn/7. 启动Yarn

7.1 单点启动

- 启动ResourceManagersh

[root@hadoop103 ~]# sudo -i -u yarn yarn --daemon start resourcemanager - 启动NodeManagersh

[root@hadoop102 ~]# sudo -i -u yarn yarn --daemon start nodemanager [root@hadoop103 ~]# sudo -i -u yarn yarn --daemon start nodemanager [root@hadoop104 ~]# sudo -i -u yarn yarn --daemon start nodemanager

7.2 群起

- 在Yarn主节点(hadoop103)配置yarn用户到所有节点的免密登录。

- 修改主节点(hadoop103)的$HADOOP_HOME/sbin/start-yarn.sh,在顶部增加以下环境变量。sh

[root@hadoop103 ~]# vim $HADOOP_HOME/sbin/start-yarn.sh ## 在顶部增加如下内容 YARN_RESOURCEMANAGER_USER=yarn YARN_NODEMANAGER_USER=yarn ## stop-yarn.sh也需在顶部增加上述环境变量才可使用 [root@hadoop103 ~]# vim $HADOOP_HOME/sbin/stop-yarn.sh ## 在顶部增加如下内容 YARN_RESOURCEMANAGER_USER=yarn YARN_NODEMANAGER_USER=yarn - 以root用户执行$HADOOP_HOME/sbin/start-yarn.sh脚本sh

[root@hadoop103 ~]# start-yarn.sh

7.3 访问Yarn web页面

7.4 启动HistoryServer

## 启动历史服务器

[root@hadoop102 ~]# sudo -i -u mapred mapred --daemon start historyserver查看历史服务器web页面 访问地址为http://hadoop102:19888

8. 安全集群使用说明

8.1 用户要求

以下使用说明均基于普通用户,安全集群对用户有以下要求:

1)集群中的每个节点都需要创建该用户

2)该用户需要属于hadoop用户组

3)需要创建该用户对应的Kerberos主体

## 创建用户(存在可跳过),须在所有节点执行

[root@hadoop102 ~]# useradd data_dev

[root@hadoop102 ~]# echo data_dev | passwd --stdin data_dev

[root@hadoop103 ~]# useradd data_dev

[root@hadoop103 ~]# echo data_dev | passwd --stdin data_dev

[root@hadoop104 ~]# useradd data_dev

[root@hadoop104 ~]# echo data_dev | passwd --stdin data_dev

## 加入hadoop组,须在所有节点执行

[root@hadoop102 ~]# usermod -a -G hadoop data_dev

[root@hadoop103 ~]# usermod -a -G hadoop data_dev

[root@hadoop104 ~]# usermod -a -G hadoop data_dev

## 创建主体

[root@hadoop102 ~]# kadmin -p admin/admin -wadmin -q"addprinc -pw data_dev data_dev"8.2 访问HDFS集群文件

## 实操:认证

[data_dev@hadoop102 ~]$ kinit data_dev

## 查看当前认证用户

[data_dev@hadoop102 ~]$ klist

## 执行命令

[data_dev@hadoop102 ~]$ hadoop fs -ls /

## 注销认证

[data_dev@hadoop102 ~]$ kdestroy

## 再次执行查看命令

[data_dev@hadoop102 ~]$ hadoop fs -ls /8.3 web页面

安装Kerberos客户端

配置火狐浏览器

8.4 提交MapReduce任务

- 认证sh

[data_dev@hadoop102 ~]$ kinit atguigu - 提交任务sh

[data_dev@hadoop102 ~]$ hadoop jar /opt/module/hadoop-3.1.3/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.1.3.jar pi 1 1